Llama 3 هو أحدث نموذج لغة كبير من Meta. يمكنك استخدامه لأغراض مختلفة، مثل حل استفساراتك والحصول على مساعدة في واجباتك المدرسية ومشاريعك، وما إلى ذلك. سيساعدك نشر Llama 3 على جهاز يعمل بنظام Windows 11 محليًا على استخدامه في أي وقت حتى بدون الوصول إلى الإنترنت. هذا المقال يوضح لك كيفية تثبيت Llama 3 على جهاز كمبيوتر يعمل بنظام Windows 11 .

كيفية تثبيت Llama 3 على جهاز كمبيوتر يعمل بنظام Windows 11

يتطلب تثبيت Llama 3 على جهاز كمبيوتر يعمل بنظام Windows 11 من خلال Python مهارات ومعرفة تقنية. ومع ذلك، تسمح لك بعض الطرق البديلة بنشر Llama 3 محليًا على جهاز يعمل بنظام Windows 11. وسوف تظهر لك هذه الأساليب.

لتثبيت Llama 3 على جهاز الكمبيوتر الذي يعمل بنظام Windows 11، يجب عليك تنفيذ بعض الأوامر في موجه الأوامر. ومع ذلك، سيسمح لك هذا فقط باستخدام إصدار سطر الأوامر الخاص به. يجب عليك اتخاذ المزيد من الخطوات إذا كنت تريد استخدام واجهة مستخدم الويب الخاصة به. سأعرض لك كلتا الطريقتين.

لن يقوم الكروم باستيراد الإشارات المرجعية من الحافة

انشر Llama 3 على جهاز كمبيوتر يعمل بنظام Windows 11 عبر CMD

لنشر Llama 3 على جهاز الكمبيوتر الخاص بك الذي يعمل بنظام Windows 11، تحتاج إلى تثبيت Ollama على جهاز Windows الخاص بك. الخطوات لنفس هي كما يلي:

- يزور الموقع الرسمي لشركة أولاما .

- انقر على تحميل زر ثم حدد ويندوز .

- الآن، انقر على تحميل لنظام التشغيل Windows زر لحفظ ملف exe على جهاز الكمبيوتر الخاص بك.

- قم بتشغيل ملف exe لتثبيت Ollama على جهازك.

بمجرد تثبيت تطبيق Olma على جهازك، قم بإعادة تشغيل جهاز الكمبيوتر الخاص بك. يجب أن يتم تشغيله في الخلفية. يمكنك رؤيته في علبة النظام الخاصة بك. الآن، انقر على خيار النماذج في موقع Ollama. وسترى نماذجها المختلفة.

يتوفر Llama 3.1 في المعلمات الثلاثة التالية:

- 8 ب

- 70B

- 405 ب

المعلمة الأخيرة هي المعلمة الأكبر ومن الواضح أنه لا يمكن تشغيلها على جهاز كمبيوتر منخفض الجودة. يحتوي Llama 3.2 على المعلمتين التاليتين:

- 1 ب

- 3 ب

انقر فوق إصدار Llama الذي تريد تثبيته على جهاز الكمبيوتر الخاص بك. على سبيل المثال، إذا كنت تريد تثبيت Llama 3.2، فانقر على Llama 3.2. في القائمة المنسدلة، يمكنك تحديد المعلمة التي تريد تثبيتها. بعد ذلك، انسخ الأمر الموجود بجانبه والصقه في موجه الأوامر.

من أجل راحتك، قمت بكتابة كلا الأمرين لنموذج Llama 3.2. لتثبيت نموذج Llama 3.2 3B، قم بتشغيل الأمر التالي:

ollama run llama3.2:3b

لتثبيت نموذج Llama 3.2 1B، استخدم الأمر التالي:

ollama run llama3.2:1b

افتح موجه الأوامر، واكتب أيًا من الأوامر المذكورة أعلاه (بناءً على متطلباتك)، ثم اضغط يدخل . سيستغرق تنزيل الملفات المطلوبة بعض الوقت. سيعتمد وقت التنزيل أيضًا على سرعة اتصالك بالإنترنت. بعد الإنتهاء سيظهر لك نجاح رسالة في موجه الأوامر.

البرنامج المساعد تحطم الكروم

الآن، اكتب رسالتك لاستخدام نموذج Llama 3.2. إذا كنت تريد تثبيت نموذج Llama 3.1، استخدم الأوامر المتوفرة على موقع Ollama.

في المرة التالية التي تقوم فيها بتشغيل موجه الأوامر، استخدم نفس الأمر لتشغيل Llama 3.1 أو 3.2 على جهاز الكمبيوتر الخاص بك.

تثبيت Llama 3 من خلال CMD له عيب واحد. لا يحفظ سجل الدردشة الخاص بك. ومع ذلك، إذا قمت بنشره على المضيف المحلي، فسيتم حفظ سجل الدردشة الخاص بك وستحصل على واجهة مستخدم أفضل. توضح الطريقة التالية كيفية القيام بذلك.

قم بنشر Llama 3 Web UI على نظام التشغيل Windows 11

يوفر استخدام Llama 3 على متصفح الويب واجهة مستخدم أفضل ويحفظ أيضًا سجل الدردشة مقارنة باستخدامه في نافذة CMD. سأوضح لك كيفية نشر Llama 3 على متصفح الويب الخاص بك.

لاستخدام Llama 3 في متصفح الويب الخاص بك، يجب تثبيت Llama 3 عبر Ollama وDocker على نظامك. إذا لم تكن قد قمت بتثبيت Llama 3 بعد، فقم بتثبيته باستخدام Ollama (كما هو موضح أعلاه). الآن، قم بتنزيل وتثبيت Docker من موقعه الموقع الرسمي .

بعد تثبيت Docker، قم بتشغيله وقم بالتسجيل لإنشاء حساب. لن يتم تشغيل Docker حتى تقوم بالتسجيل. بعد التسجيل، قم بتسجيل الدخول إلى حسابك على تطبيق Docker. تصغير Docker إلى علبة النظام. يجب أن يتم تشغيل تطبيقات Docker وOllama في الخلفية. بخلاف ذلك، لا يمكنك استخدام Llama 3 في متصفح الويب الخاص بك.

كيفية مشاركة مقاطع اكس بوكس ون على الفيس بوك

الآن، افتح موجه الأوامر، انسخ الأمر التالي والصقه في موجه الأوامر:

docker run -d -p 3000:8080 --add-host=host.docker.internal:host-gateway -v open-webui:/app/backend/data --name open-webui --restart always ghcr.io/open-webui/open-webui:main

سيستغرق الأمر أعلاه بعض الوقت لتنزيل الموارد المطلوبة. لذلك، التحلي ببعض الصبر. بعد الانتهاء من الأمر، افتح Docker وحدد حاويات القسم من الجانب الأيسر. سترى أن الحاوية يتم إنشاؤها تلقائيًا باستخدام المنفذ 3000:8080.

انقر على المنفذ 3000:8080. سيؤدي هذا إلى فتح علامة تبويب جديدة في متصفح الويب الافتراضي الخاص بك. الآن، قم بالتسجيل وتسجيل الدخول لاستخدام Llama 3 على متصفح الويب الخاص بك. إذا رأيت شريط العناوين، فسوف ترى المضيف المحلي: 3000 هناك، مما يعني أن Llama 3 مستضاف محليًا على جهاز الكمبيوتر الخاص بك. يمكنك استخدامه دون اتصال بالإنترنت.

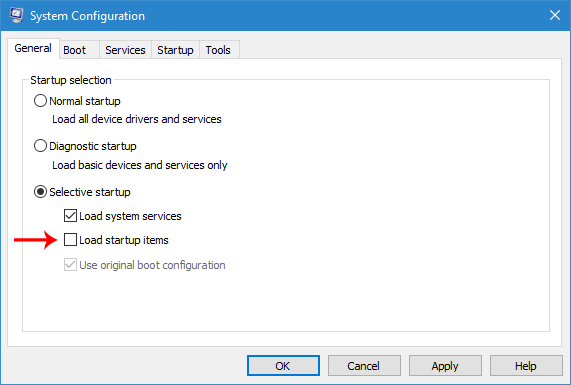

تعليق انتقائي

حدد نموذج دردشة Llama الخاص بك من القائمة المنسدلة. إذا كنت ترغب في إضافة المزيد من نماذج الدردشة لـ Llama 3، فيجب عليك تثبيتها عبر Ollama باستخدام الأوامر المطلوبة. بعد ذلك، سيكون النموذج متاحًا تلقائيًا في متصفح الويب الخاص بك.

سيتم حفظ كل سجل الدردشة الخاص بك ويمكن الوصول إليه على الجانب الأيسر. عندما تريد الخروج، قم بتسجيل الخروج من جلستك في متصفح الويب الخاص بك. بعد ذلك، افتح تطبيق Docker وانقر على قف زر لإيقاف عامل الميناء. الآن، يمكنك إغلاق Docker.

عندما تريد استخدام Llama 3 في متصفح الويب الخاص بك في المرة القادمة، قم بتشغيل Ollama وDocker، وانتظر لبضع دقائق، ثم انقر فوق المنفذ الموجود في حاوية Docker لفتح خادم المضيف المحلي في متصفح الويب الخاص بك. الآن، قم بتسجيل الدخول إلى حسابك وابدأ في استخدام Llama 3.

آمل أن يساعد هذا.

هل يمكن تشغيل Llama 3 على نظام Windows؟

اعتمادًا على تكوين أجهزة الكمبيوتر لديك، يمكنك تشغيل Llama 3 على نظامك. نموذجه 1B هو الأخف وزنا. يمكنك تثبيته وتشغيله على نظامك من خلال موجه الأوامر.

ما مقدار ذاكرة الوصول العشوائي التي أحتاجها للعبة Llama 3؟

أخف طراز من Llama 3 هو Llama 3.2 1B. يجب أن يحتوي نظامك على 16 جيجابايت من ذاكرة الوصول العشوائي (RAM) لتشغيل طراز Llama 3.2 1B. بالإضافة إلى ذلك، يجب أن يحتوي نظامك أيضًا على وحدة معالجة رسومات عالية التحمل. تتطلب النماذج الأعلى من Llama 3 المزيد من موارد النظام.

اقرأ التالي : كيفية استخدام ليوناردو فينيكس AI .